📌 本文重點

- 把複雜血糖數據轉成「可讀故事」

- 不碰醫療決策,只做分析與提醒

- 可自託管,延伸到睡眠、運動等健康指標

- 工程師與非工程師都有明確上手路徑

這是一個把連續血糖、胰島素泵、Nightscout 和聊天式分析整合在一起的開源 AI 健康管家,但不碰醫療決策,專心把你的血糖數據講成聽得懂的故事。

專案連結:GlycemicGPT GitHub

核心功能:它到底幫你做什麼?

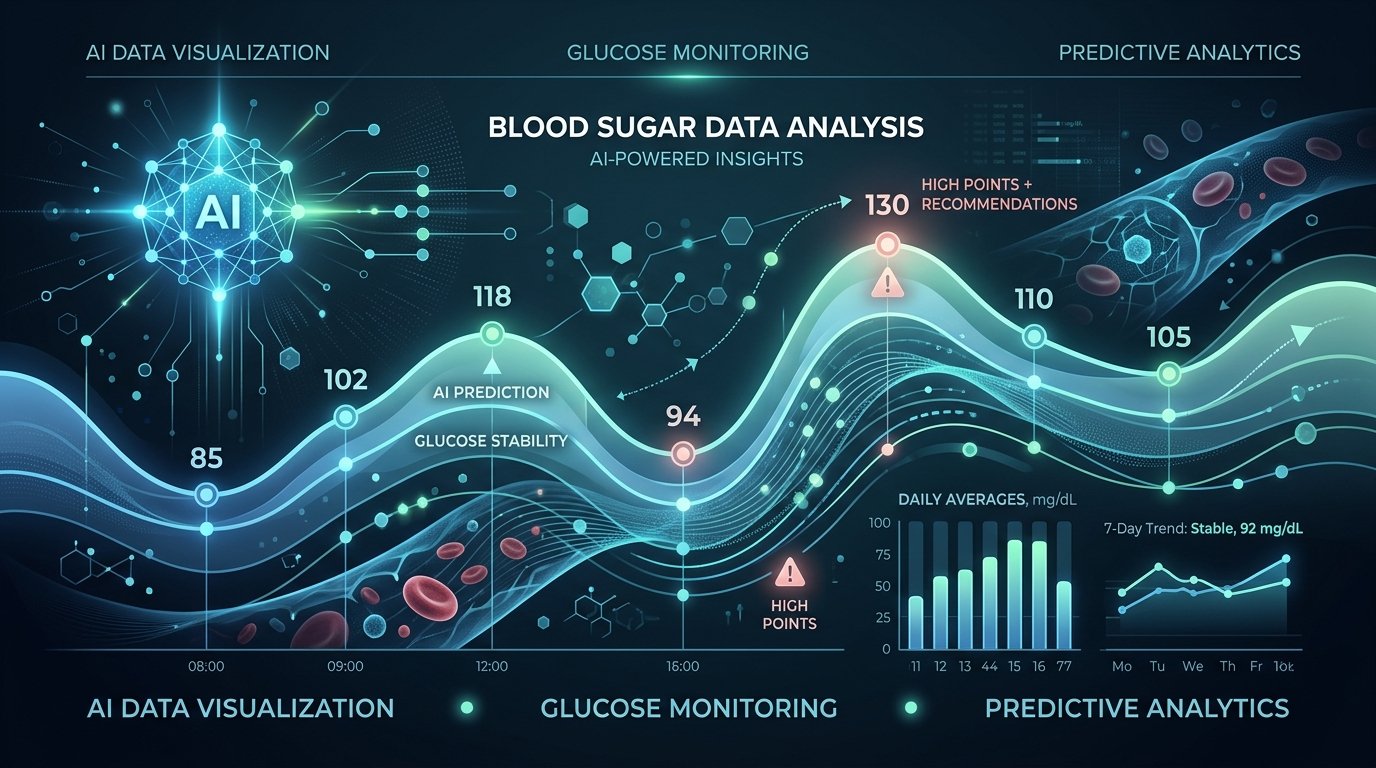

1. 把一天血糖變成「可讀摘要」

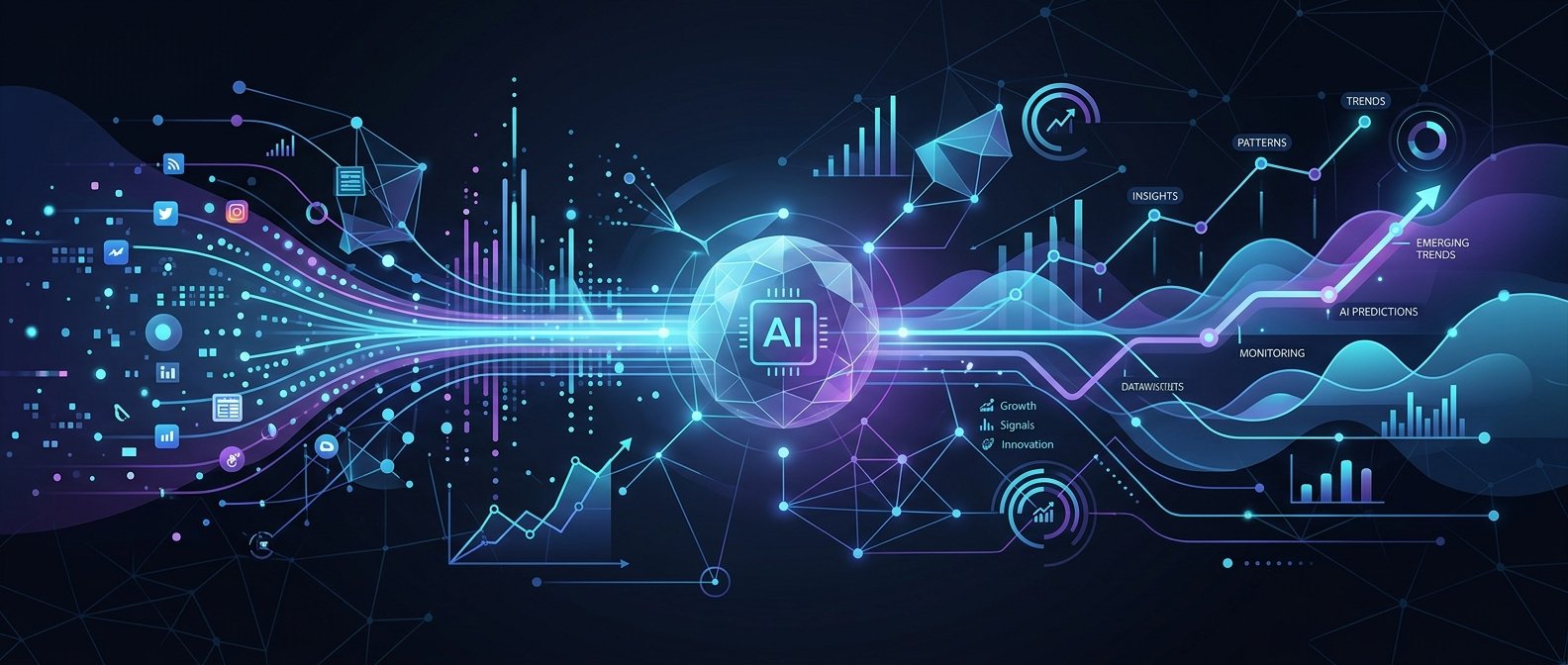

解決的問題:連續血糖監測(CGM)數據很多,但圖表看了還是不知道:今天到底穩不穩?哪一段出問題?

GlycemicGPT 的做法:

– 從 Dexcom G7、Nightscout 等來源抓你的 24 小時血糖紀錄

– 分成「夜間」「白天」「運動前後」「高低血糖事件」等片段

– 生成一段自然語言摘要,例如:

– 「昨晚 2–4 點有兩次低血糖,可能和睡前校正注射有關」

– 「早餐後 1–2 小時血糖上升幅度較大,建議檢視碳水估算」

💡 關鍵: 把一整天密密麻麻的血糖數據濃縮成幾句話,讓你一眼看出哪個時段最需要注意。

你可以馬上做的事:

– 每天固定時間(例如睡前)看一次摘要,記一條「明天要嘗試的調整」:

– 減少某餐碳水

– 提前運動時間

– 記錄一個你想問醫師的問題

2. 餐後血糖分析:把「這餐」跟「那餐」比較出來

解決的問題:你可能知道「麵會讓我高」,但很難量化:這碗麵 vs 這碗飯,到底差多少?

GlycemicGPT 的做法:

– 從 Nightscout 或手動輸入的「餐點紀錄」對應到餐後血糖曲線

– 幫你計算:

– 餐後 1 小時、2 小時的血糖變化

– 每道菜、不同時間吃同一餐的差異

– 用自然語言生成結論:

– 「相較於 5 月 1 號午餐,同樣是義大利麵,今天餐前血糖較高,使得峰值提高約 20 mg/dL」

💡 關鍵: 透過具體數字比較不同餐次,幫你找出「同一道菜、不同吃法」帶來的血糖差異。

你可以馬上做的事:

– 選一個常吃的餐(例如便當店),連續 3 次記:

– 吃什麼

– 大概時間

– 用 GlycemicGPT 問:「幫我比較這 3 次便當餐後血糖差異」

– 找出:

– 是否晚吃一小時就特別高

– 是否換一種配菜更穩

3. 聊天式 Q&A 與預警:把醫囑變成「日常提醒」

解決的問題:醫院給的講義很厚,但日常遇到的小問題(例如「今天運動前 30 分鐘血糖是 90,合理嗎?」)很難即時問人。

GlycemicGPT 的做法:

– 使用 RAG(從可信來源取資料再回答),連結臨床指南、糖尿病教育資料

– 你可以問:

– 「這週夜間低血糖發生幾次?」

– 「最近是否有高血糖時間變長?」

– 設定預警:

– 當血糖連續一段時間偏高/偏低時,以你設定的方式提醒(例如透過 Nightscout 或其他通知系統)

安全邊界(很重要):

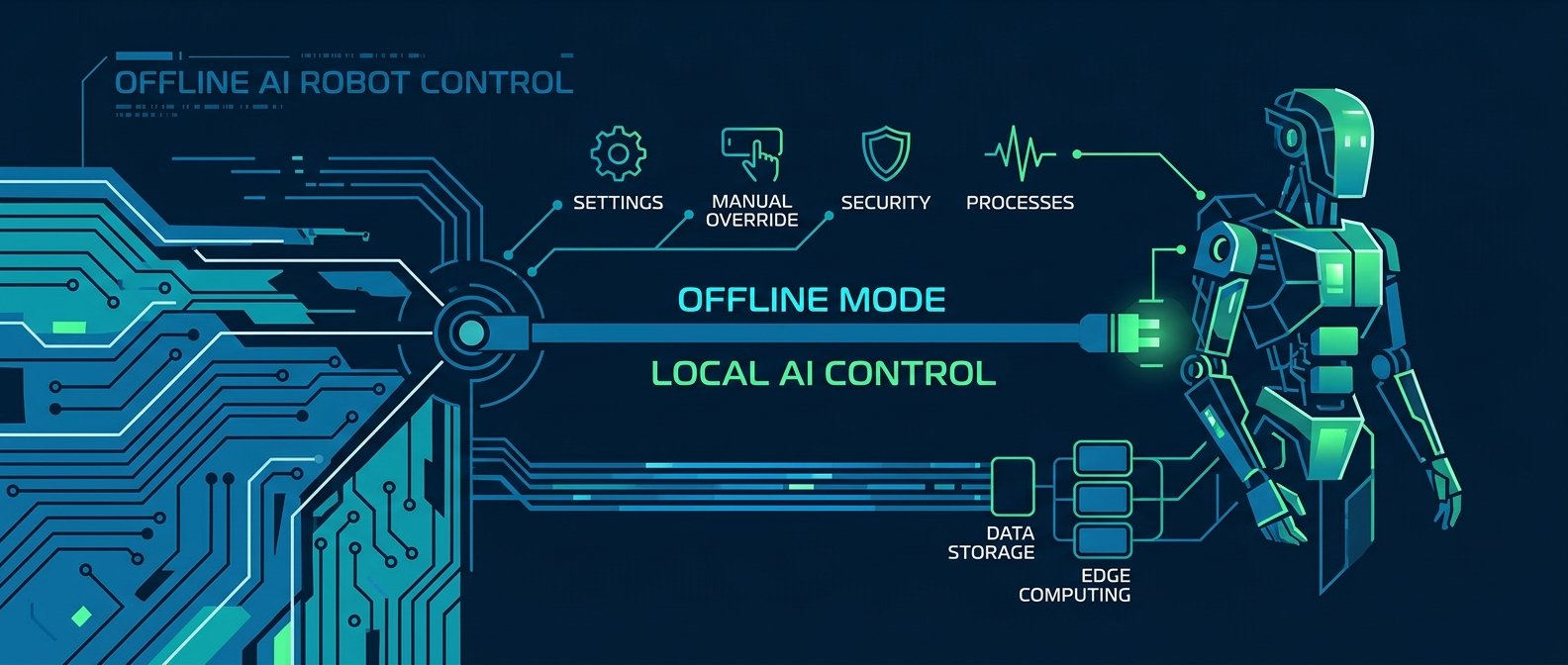

– GlycemicGPT 不控制胰島素泵,不會自動調整劑量

– 它是「分析與提醒工具」,任何治療改變都應與醫師討論

💡 關鍵: 系統刻意不碰胰島素劑量,只做「看懂與提醒」,讓使用更安全、也更符合醫療規範。

你可以馬上做的事:

– 選一個你常擔心的情境,例如:「運動前低血糖」

– 問 GlycemicGPT:

– 「過去兩週,我運動前 2 小時內有低血糖的情況嗎?」

– 把得到的結論帶去門診,跟醫師一起確認需不需要調整

適合誰用?三種典型場景

1. 糖尿病患者:把自我管理變成「對話」

適合:已經在用 Dexcom G7、Nightscout 或胰島素泵的 1 型/2 型患者。

可以怎麼用:

– 每週固定生成一份「一週血糖報告」

– 把報告存在雲端或印出,在門診時直接給醫師看

– 平常遇到疑問先在 GlycemicGPT 裡「排練」問題,再整理 2–3 個重點問醫師

2. 家屬與照護者:遠端關心但不干擾

適合:家裡有小孩、長輩正在使用 CGM 或胰島素泵。

可以怎麼用:

– 由患者端自託管 GlycemicGPT,授權家屬查看摘要

– 家屬每週只看一次「高低血糖事件概況」,避免盯得太緊造成壓力

– 把預警設定為「只在連續幾天異常時通知」,減少過度打擾

3. 醫療團隊:作為視覺化與溝通工具

適合:願意嘗試資料驅動照護的診所、醫師、糖尿病衛教師。

可以怎麼用:

– 在院內一台伺服器上自託管,連接部分願意參與的患者 Nightscout

– 診間中開 GlycemicGPT 的每日摘要,當作溝通起點:

– 「這裡可以看到你這一週夜間血糖偏低,我們一起討論原因」

再次提醒:治療決策仍然由醫師與患者共同做出,GlycemicGPT 只是把資料講清楚。

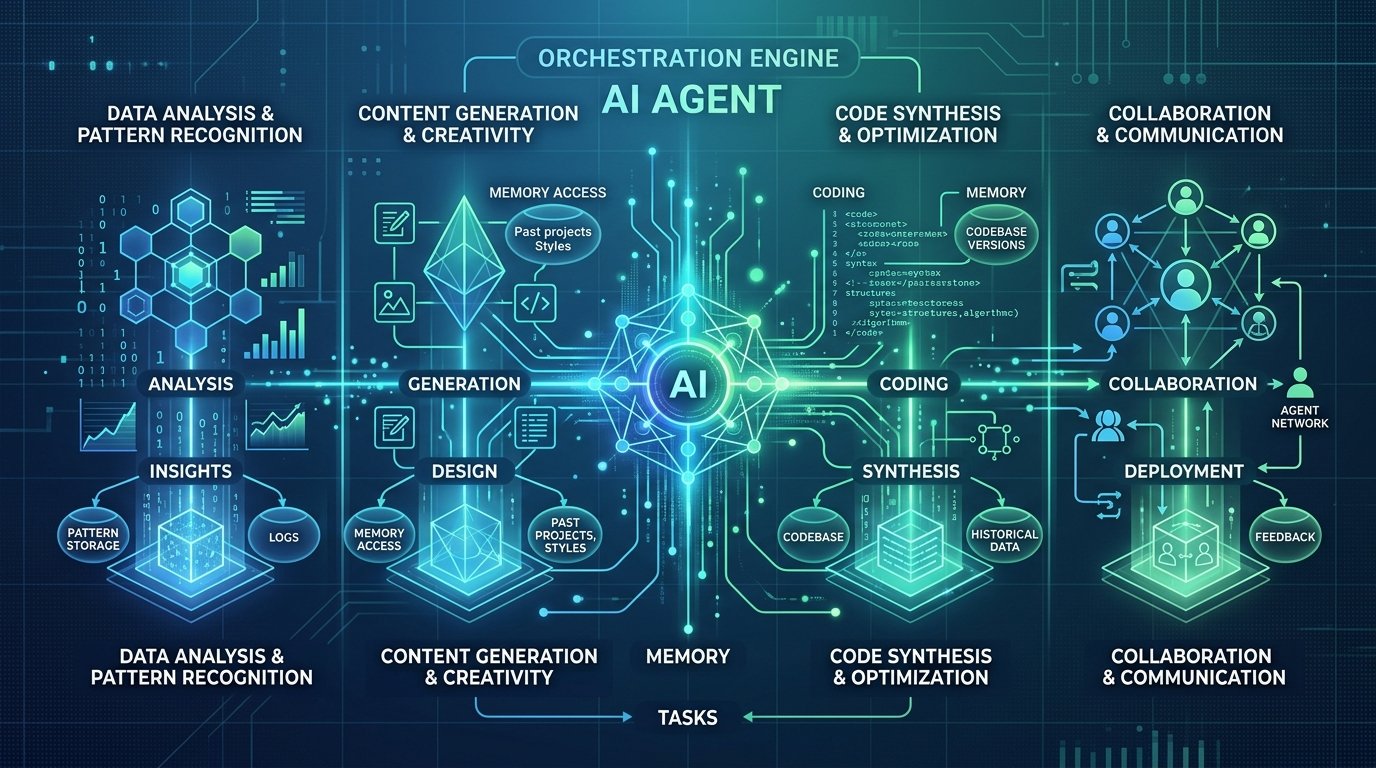

延伸思路:用同一套架構做「睡眠 / 運動 / 壓力」Agent

就算你不是糖尿病患者,也可以從 GlycemicGPT 學到一套「個人健康 Agent」的設計模板:

- 資料來源:

- 睡眠:Apple Watch、Oura Ring、床墊感測器

- 運動:Garmin、Strava、健身房紀錄

- 壓力:心率變異度(HRV)、自我打分

- 管道層(類似 Nightscout):

- 建一個簡單的時間序列資料庫(例如 InfluxDB、TimescaleDB)

- AI 分析層:

- 用類似 GlycemicGPT 的方式:

- 每日摘要

- 特定事件分析(熬夜、重訓日)

- 聊天式 Q&A

具體行動建議:

– 先選一個最在意的指標(例如「睡眠中途醒來」)

– 用 Notion / Google Sheet 先手動記一週

– 再思考要怎麼把它自動化收集,最後才上 AI 分析層

怎麼開始:非工程師 vs 工程師兩條路

非工程師:先找到願意幫你部署的人

目前 GlycemicGPT 是一個自託管專案,沒有一鍵雲端 SaaS,可以照這個路線:

- 準備好問題清單:

- 想解決什麼?(例如「看懂 Dexcom 圖表」「整理給醫師的報告」)

- 請技術朋友或社群幫忙部署:

- 把這個連結丟給對方:https://github.com/GlycemicGPT/GlycemicGPT

- 請他們依 README 在以下任一環境部署:

- VPS(例如 Hetzner、DigitalOcean)

- 家用 NAS / 自架伺服器

- 樹莓派(性能較有限,但可做測試)

- 確認三件事再上線:

- 資料只存在你控制的機器

- 只有你(和你信任的人)有權登入

- 不啟用任何自動控制胰島素的機制

如未來專案提供雲端部署模板(例如 Docker Compose + 一鍵部署到某雲平台),可直接使用模板,仍建議由你信任的技術人員操作。

工程師:自己 clone、自己玩(含模擬數據)

步驟 1:Clone 專案

git clone https://github.com/GlycemicGPT/GlycemicGPT.git

cd GlycemicGPT

步驟 2:設定資料來源

你有三種常見選項:

– Dexcom G7:

– 依 README 取得雲端 API 權限

– Tandem t:slim X2 / Mobi:

– 透過 BLE 連線(需支援藍牙的裝置)

– Nightscout:

– 指向你現有的 Nightscout URL 和 API key

– 沒有真實設備也沒關係:

– 使用專案提供的模擬數據(或自己寫一段腳本產生假資料),先跑通流程

步驟 3:選擇 LLM:本地或雲端

- 本地模型(例如搭配 Ollama):

- 適合:在意隱私、手邊有一台效能還可以的電腦

- 做法:

bash

# 安裝 Ollama(依官網步驟)

ollama pull llama3 -

在 GlycemicGPT 設定檔中改成指向本地 Ollama 的 API

-

雲端 LLM(OpenAI、Anthropic 等):

- 適合:先追求穩定與效果

- 做法:

- 取得 API Key

- 在環境變數或設定檔中填上

步驟 4:跑起第一個每日摘要

- 啟動服務(依 README,多半是

docker-compose up或類似指令) - 匯入一段 24 小時的血糖資料

- 在 Web 介面或命令列呼叫「Daily brief」功能

你應該會看到類似:

「過去 24 小時,Time in Range 為 72%,夜間低血糖兩次,主要集中在 2–3 AM。」

從這裡開始,你可以:

– 修改提示詞(prompt)讓語氣更符合自己

– 加入自訂指標(例如:運動前 2 小時血糖平均值)

實務提醒:隱私、醫療決策與客製指標

- 隱私與自託管:

- 血糖與醫療資料是極具敏感性的個資

-

優先考慮:

- 自己控制的伺服器

- 本地模型(如 Ollama)

- 關閉不必要的遙測或第三方整合

-

與醫師討論後再調整治療:

- GlycemicGPT 可以提出「假設」:

- 「這段時間似乎與晚餐進食時間延後有關」

- 但任何:

- 胰島素劑量修改

- 藥物新增或減少

- 大幅飲食調整

-

都應先與醫師或糖尿病衛教師確認

-

迭代客製自己的健康指標:

- 起點:先用官方常見指標(Time in Range、低血糖事件次數)

- 接著加上個人化指標,例如:

- 「健身日前後 12 小時的血糖穩定度」

- 「出差期間 vs 非出差期間的平均血糖」

- 每一輪調整只增加 1–2 個新指標,避免系統變得看不懂

延伸閱讀與靈感來源

- GlycemicGPT 專案(Hacker News 貼文):https://news.ycombinator.com/item?id=XXXX(可從 GitHub 連回)

- 睡眠案例:作者用 AI 分析自己夜間醒來原因的故事:https://martin.sh/i-let-ai-build-a-tool-to-help-me-figure-out-what-was-waking-me-up-at-night/

- 本地 AI Agent 架構例子(ml-intern):https://github.com/huggingface/ml-intern

如果你正在想「AI 到底能在我的健康管理中做到哪裡」,GlycemicGPT 是一個很好的起點:

– 它先專注把資料變成可讀故事

– 把決策留給你和醫師

– 同時也給了我們一套可複製到其他健康領域的架構範本。

🚀 你現在可以做的事

- 打開 GlycemicGPT GitHub 專案,確認自己屬於「非工程師」還是「工程師」路線

- 選一個近期最在意的情境(例如「夜間低血糖」或「某個常吃的便當」),準備一週的相關紀錄

- 找一位可信任的技術朋友,或自己依 README 部署雛形,先跑出第一份「24 小時血糖摘要」再逐步優化