📌 本文重點

- AI 已讓零日攻擊與供應鏈攻擊走向自動化與規模化

- 90 天修補窗口已失效,防禦必須用 AI 對齊攻擊速度

- 安全 AI agent 應成為企業級基礎設施而非玩具

AI 驅動的網路攻擊已經不是「未來風險」,而是正在發生的「既成事實」。如果你還只把 LLM 當作寫文件、產生 demo 的小幫手,而不是下一代攻防基礎設施,你的團隊其實已經在下一波網路戰裡,排隊等著當靶子。接下來幾年,真正的分水嶺不在「有沒有用 AI」,而在於:你的安全體系,有沒有讓 AI 上場。

一、Google 零日 + TanStack + 30 分鐘 exploit:攻擊工具鏈已經「自動化 + 規模化」

Google Threat Intelligence Group 最近公開的報告,是個象徵性時刻:首次高信心確認,一個零日攻擊 exploit 是在 AI 協助下開發出來的。

- 攻擊目標:未具名的開源網頁系統管理工具

- 風險:可繞過雙重驗證,用來發動「mass exploitation event」

- 技術線索:程式碼中出現虛構的 CVSS 分數、結構化、教科書式範例風格——典型 LLM 生成痕跡

這不是「AI 幫忙補幾行程式」而已,而是:

- 利用 LLM 做漏洞探測、變體生成、payload 組合

- 形成半自動化的攻擊流水線,可以一次掃遍大量開源專案與雲端服務

同一週,你在 TanStack npm 供應鏈攻擊 的復盤裡會看到另一個關鍵訊號:

- 攻擊者利用發布流程和信任鏈,讓自我擴散的 npm 蠕蟲,把 release automation 直接變成惡意程式散佈系統

- 當這套流程加上 LLM,自動改寫、混淆、適配不同目標環境,每次發版就成了一次攻擊波

再疊加 The Decoder 報導的數字:

AI 可以在 30 分鐘內,把一個公開的 patch 反向工程成可行 exploit,而不是過去假設的「90 天披露視窗」。

💡 關鍵: 從「30 分鐘出 exploit」到「90 天修補窗口」的落差,代表傳統修補節奏在 AI 攻擊面前已完全失效。

這三件事合在一起,代表什麼?

- 零日不再稀缺:有 AI 的攻擊者,可以把「找洞」當日常背景任務跑,用 agent 不停 fuzz 各種系統、協定、套件。

- 武器化速度指數級加快:從 commit 出現的那一刻起,計時單位不再是天或週,而是分鐘。

- 攻擊開始「工業化」:Google 已經點名,中國、北韓、俄羅斯國家級行為者都在用 AI 生成與隱匿惡意程式碼,這不是 hobby hacker,用的是有預算、有治理的工具鏈。

產業如果還把 LLM 當成「寫 spec 的 intern」,是在對著一支已經 AI 武裝完畢的對手,光著身體上戰場。

二、從維護者到 CISO:你以前以為可接受的風險,現在都不夠看

1. 開源維護者:依賴樹掃不完,攻擊者卻有無限 agent

TanStack 事件暴露一個殘酷現實:

- 主流 JS 專案動輒上千個 transitive dependencies

- 真正有時間逐一審查的維護者幾乎不存在

過去你的對手也很累,要人工手動挑戰目標。現在不一樣:

- 攻擊者可以丟給 AI 批次閱讀 release note、commit 訊息、CHANGELOG,自動標記「可能含安全修補」的版本

- 再用 AI 自動生成 PoC,掃遍整個 npm / PyPI / Maven 生態

結果就是:

- 你沒時間看完的依賴樹,攻擊者有 AI 幫他看完

- 你的評估節奏如果還停留在「每季安全 review」,就是把整季的暴露面,打開給自動化掃描器

💡 關鍵: 人類難以處理的巨量依賴與變更閱讀,正好是 AI 的強項,攻擊者已經在用這個不對稱優勢。

2. 企業 CISO:90 天修補視窗已經被 AI 毀掉

傳統漏洞披露規範喜歡談 90 天修補窗口。但在「patch 30 分鐘變 exploit」的世界:

- 補丁 push 上去的當下,防守方與攻擊方看到的是同一份 diff

- 唯一差別是:攻擊者更有誘因、也更願意砸算力,用 AI 把它變現

這對 CISO 有幾個直接含義:

- 風險時間軸縮到「小時計」:安全例會開完、變更流程簽完,攻擊都已經上線。

- 「先修內部、再等 90 天公告」的策略破產:只要你還在灰度 rollout,互聯網上就已經有人在 fuzz 同一個 patch。

- 資安預算結構要調整:花錢在更多「人力審查」已經不是解法,你需要的是能跟 AI 攻擊速度對齊的 AI 防禦。

如果 CISO 還用「年度計畫」思維看待這件事,本質上就是把防守節奏鎖死在上一個時代。

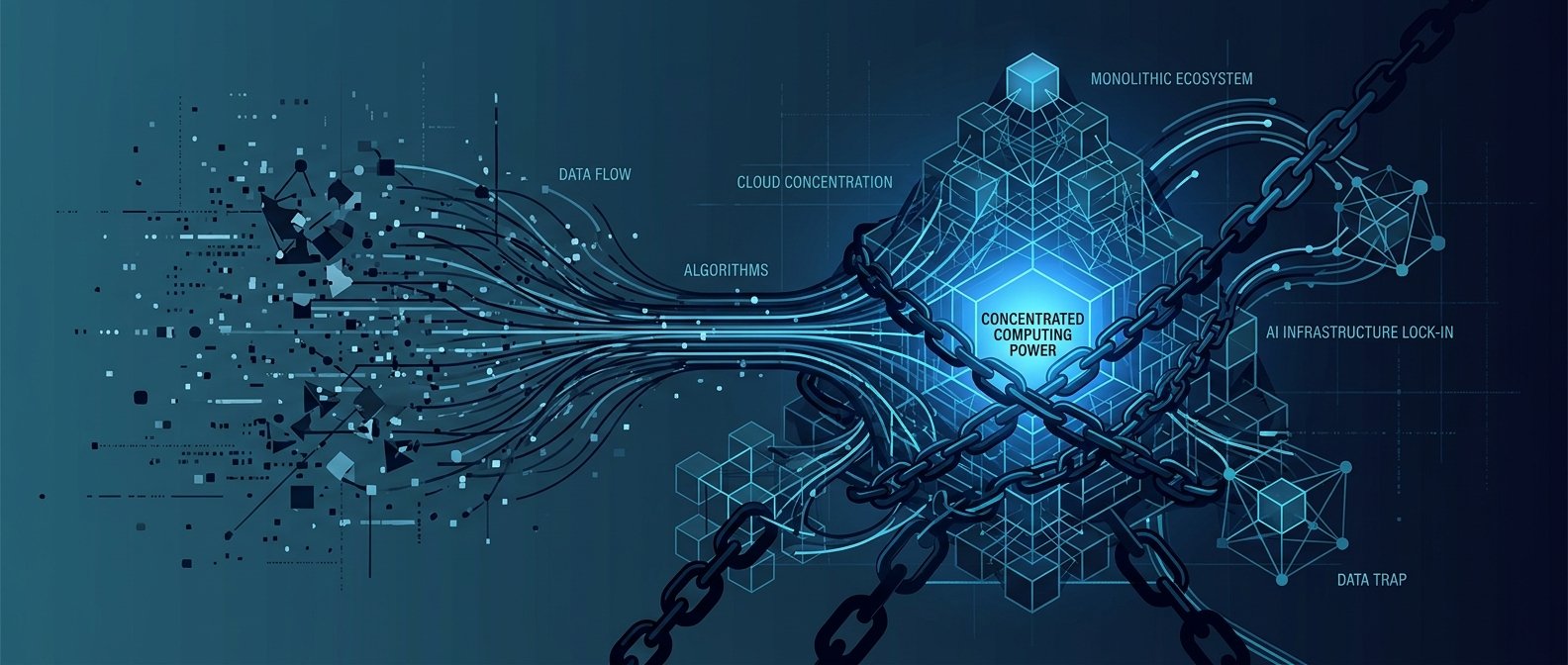

3. SaaS 團隊:單一 LLM 當機 = 關鍵系統直接斷電

另一個被低估的風險,是把 LLM 當成黑盒 SaaS 依賴的系統性脆弱性。

Towards AI《The Silicon Protocol》 模擬的 2025/6/10 OpenAI 15 小時 outage,其實已經很接近現實:

- 340 家醫院的臨床 AI 系統同時癱瘓

- 緊急分診時間從 18 分鐘飆到 47 分鐘

- 影響 12,000+ 醫師、48 萬次病患互動

- 金融交易、政府補助審核一併停擺

💡 關鍵: 當單一 LLM 供應商成為醫療與金融等關鍵系統的單點故障時,穩定性就等同於安全性。

這個故事的重點不是「OpenAI 不穩」,而是:

- 你把 LLM 當成核心業務邏輯的一部分,卻沒有任何真正的容錯策略

- 一個 API 掛掉,就讓醫療、金融、政務整條鏈路被 AI 單點故障拖下水

在 AI 武器競賽裡,穩定性本身就是安全性的一部分。你不能一邊擔心對手用 AI 來打你,一邊又把自己的生命線綁在單一 AI 供應商上。

三、把「安全 AI agent」當基礎建設,而不是玩具

如果攻擊和防禦都勢必 AI 化,那當務之急不是「要不要用 AI」,而是你要先讓哪一邊 AI 化。

我的具體主張是:企業應該把安全 AI agent 視為和 CI/CD、觀察性平台同等級的必備基礎設施,而不是創新實驗室的 side project。

具體來說,有三個落地方向:

1. 把防禦型 agent 綁進 CI/CD pipeline

參考 OpenAI Daybreak、Claude Mythos 這類防禦型 agent 的思路:

- 在 PR / merge 前,強制跑一層「AI secure code review」,針對認證、權限邊界、注入、序列化等高風險區塊給出阻擋級建議

- 新的依賴被加入時,agent 自動:

- 解析其 transitive dependencies

- 對 changelog / issue / CVE 記錄做語意掃描

- 給出「風險評級 + 建議替代方案」

這不是「多一個便利工具」,而是把人類不擅長的大規模重複閱讀工作,直接交給 AI。

2. 在營運監控中佈署「紅隊風格 agent」

你遲早會遇到 AI 驅動的紅隊,最好是先有自己的:

- 持續對你的外部攻擊面(域名、API、開放服務)進行自動化攻擊模擬

- 定期嘗試利用已知 CVE、misconfig、過期依賴,並把結果饋入風險儀表板

關鍵是 mindset:不要等真實攻擊者幫你做滲透測試。你的 AI agent 應該比對手先一步找到同樣的洞。

3. 把「AI 依賴治理」寫進公司級規範

最後,是治理與預算層面要跟上:「攻擊與防禦都會 AI 化」應該變成董事會與監管對話中的顯性假設:

- 制定 LLM 依賴政策:

- 不得只有單一 LLM 供應商

- 必須有降級路徑(rule-based fallback、第二供應商、離線模型)

- 資安與平台預算中,要明確列出AI 防禦基建項目,而不是把它擠在「創新實驗」下面

- 對外回應監管機構時,直接承認:沒有 AI 的防禦是落後的防禦,並說清楚你的 AI 控制措施(資料隔離、權限、審計)

給開發者與團隊的結論:先決定你要站在哪一邊的時間線上

AI 已經在幫人寫零日攻擊碼、在 30 分鐘內把 patch 變 exploit、把供應鏈攻擊規模化。這不是「會不會發生」的問題,而是「你要在它普及前還是普及後,才開始防守」的問題。

對開發者與團隊,我的具體建議是:

- 今年就把一個防禦型 AI agent 接進 CI/CD,哪怕只先做 code review 和依賴分析。

- 把你的 LLM 依賴畫成圖,問自己:這個點掛掉,哪些服務會立即停擺?沒有備援,就安排 roadmap 做。

- 在下一輪預算或 OKR 設定時,明文提出「AI 強化安全」而不是「AI 生產力實驗」,讓安全團隊主動擁有這支工具。

在 AI 資安武器競賽裡,你沒有選擇「要不要參戰」的權利,只有「要不要還用人力跑步去追一輛裝了渦輪的卡車」。趕快讓自己的防禦體系,也裝上 AI 引擎。現在開始,還來得及。

🚀 你現在可以做的事

- 在現有 CI/CD pipeline 中接入至少一個防禦型 AI agent,先從程式碼與依賴安全檢查開始

- 畫出團隊對各家 LLM 的依賴拓樸圖,標記單點故障並規劃第二供應商或離線備援

- 在下一次年度規劃或 OKR 會議中,把「AI 強化安全」列為獨立目標,由安全或平台團隊負責落地