📌 本文重點

- Google 企圖把 OS 重寫為 Agent 優先的平台

- 平台競爭從「搶入口」轉向「搶工作流程」

- 開發者需同時服務「人類」與「Agent」兩條產品線

Google I/O 2026 的真正賭注,不在於 Gemini 4 有多強,而是要把作業系統重寫成一個為 Agent 服務的「新 API 平台」。如果這一步成功,應用程式的單位將從「App」變成「工作流程」,OS 的主戰場也會從桌面 UI 轉移到 Agent 流程調度。**

這次的產品組合——Gemini 4、Aluminium OS、Android XR、AI 眼鏡,再加上與 Apple 的合作——本質上是 Google 在打同一場仗:把 Agent 拉到「系統層」而不是「App 層」來運作,並試圖重寫平台規則。

一、Google 的真正企圖:把 Agent 變成「新一代 App」

從開發者視角看,這場 I/O 有三個關鍵訊號:

- 模型:Gemini 4 的定位從「聊天模型」轉向「行動執行引擎」

不管 Google 怎麼包裝 Gemini 4 的推理能力提升,最重要的不是 SOTA benchmark,而是:

- 它被綁在 Aluminium OS 的系統層,

- 被接到

Android XR的跨裝置 runtime, - 被塞進 AI 眼鏡這種「長時間在場」的介面。

這意味著:Google 不再把模型當雲端 API,而是當 OS 的核心 runtime。

- OS:Aluminium OS 是「Agent-first OS」,不是 Chrome OS 2.0

Aluminium OS 的關鍵不在 UI,而在 系統 API 結構:

- OS 內建 Agent 層:檔案、行程、通知、網路權限都可以被 Agent 調度;

- 支援 離線/邊緣推理:在端上跑縮小版

Gemini 4,減少對雲端的依賴; - 更細緻的 權限與審計機制:讓 Agent 能在可監管的軌道內運作。

這對開發者意味著:

- 你不再只是寫前端 UI 或後端 API,而是寫「可被 Agent 調用的能力模組」;

- 你的 App 可能沒有使用者介面,只有被 Agent 呼叫的

workflows; -

「寫給人用」與「寫給 Agent 用」 會分成兩種產品線。

-

跨端:Android XR 不是新系統,是新「執行邏輯」

Android XR 被描述成「跨手機、機器人、車載、眼鏡」的統一平台。從 Agent 角度看,它在做的是:

- 把不同終端的 感知能力(感測器、鏡頭、麥克風) 和 行動能力(通知、撥號、支付、控制設備) 抽象成一組可調用的 API;

- 讓同一個 Agent 可以跨裝置持續任務,而不是每一台裝置都跑一個孤立

chatbot。

💡 關鍵: Google 正在把 OS 從「人點按的介面」重構為「Agent 調用的能力平台」,讓模型變成系統級 runtime,而非單純雲端 API。

結論是:Google 正在把 OS 從「人點按的介面」重構為「Agent 調用的能力平台」。 這也是為什麼這次 I/O 會被視為一次真正的「平台嘗試」,而不只是模型發表會。

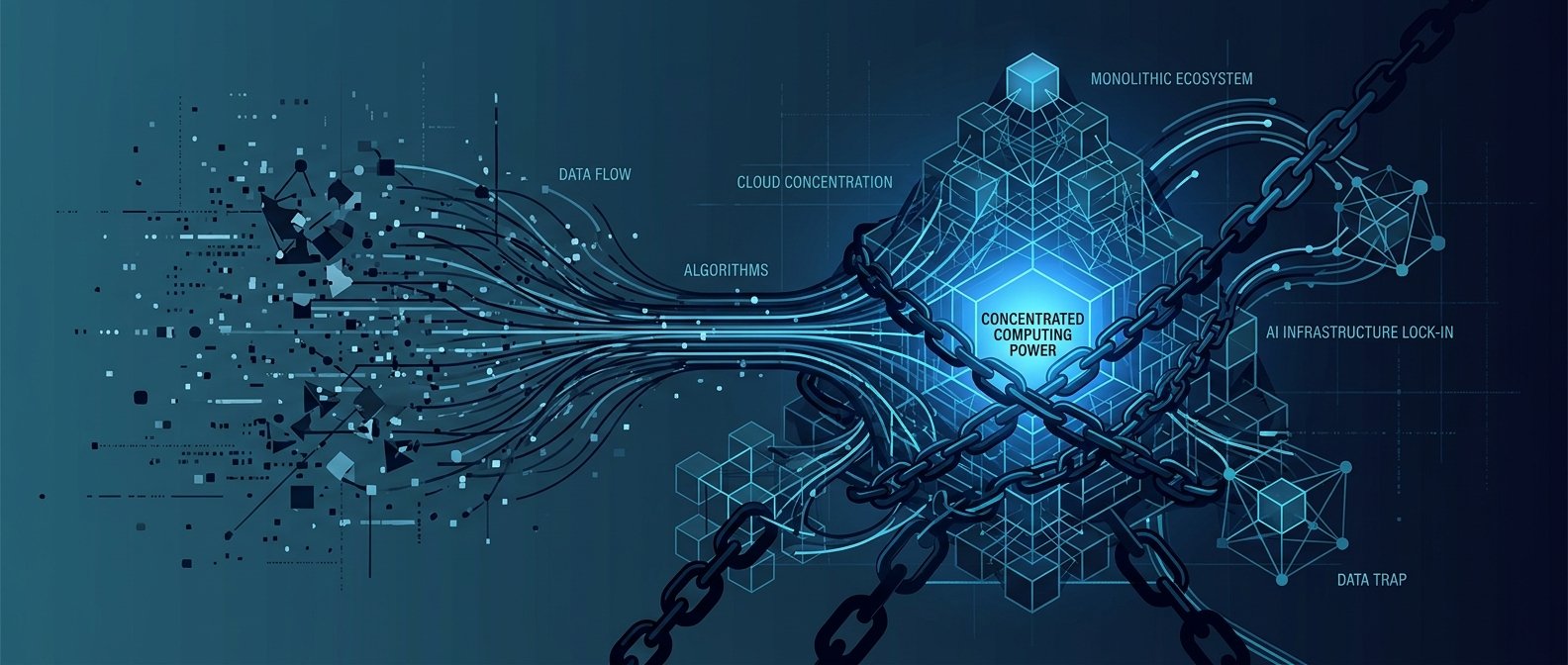

二、入口 vs. 工作流程:Google、Apple、OpenAI、Anthropic 的路徑分叉

產業策略上,現在 AI 平台分成兩條線:搶入口 vs. 搶工作流程。

1. Google × Apple:誰掌控 iPhone 的預設 Agent?

最敏感的一步,是 Google 與 Apple 的合作。若 Gemini 成為 Siri 背後的推理引擎,或至少成為 iOS 上的某種預設 AI 選項,這會帶來幾個後果:

-

入口層主權切割:

-

Apple 繼續掌控 UI、隱私策略、系統權限與「預設選擇」;

- Google 則掌控背後的語言推理與部分 Agent 能力。

這讓 iPhone 的 AI 體驗變成「Apple 皮 + Google 大腦」。

- 預設選擇戰升級為「預設 Agent 戰」:

這已不是預設搜尋引擎的戰爭,而是預設 日常任務被誰的 Agent 接管:

- 你在 iPhone 上說「幫我安排明天行程」,是 Apple 的本地 Agent 處理?還是交給 Google 的雲端 Agent?

- Apple 會限制第三方 Agent 的系統權限,保持「入口控制權」,但這次不得不讓出部分「推理能力」給 Google。

換句話說:Apple 在守入口,Google 在滲透工作流程——雙方是互相利用,也是在預設 AI 的控制權上互相牽制。

2. OpenAI:用 DeployCo 搶「企業工作流程」

對比之下,OpenAI 走的是另一條線:從 ChatGPT 入口做到 DeployCo 這種深度整合。根據 The Decoder 對 DeployCo 的分析:

- OpenAI 借鏡 Palantir,把 AI 深度嵌入企業運營,

- 透過顧問+實作,打造「實務工作流程壁壘」,

- 重點不在 OS,而在「把模型變成企業習慣的工作方式」。

再對照 OpenAI 官方在「How enterprises are scaling AI」強調的:

- 信任機制、治理架構、工作流設計、質量監控——這些都是 Agent 真正落地的前提;

- 企業端看的是 可控性與治理,而不是模型多聰明。

OpenAI 的策略是:不搶裝置入口,而是搶企業的業務流程。入口可能在 Microsoft、在瀏覽器、在第三方 App,但最後的「AI 工作流內核」由它主導。

3. Anthropic & AWS:把 Agent 變成「企業級服務層」

Anthropic 則靠著 Claude 平台在 AWS 一般可用,把自己鎖定在 企業雲端層:

- 透過 Claude Managed Agents,提供多 Agent、代碼執行、網頁搜尋、

Files API等完整能力; - 與 Amazon Bedrock 並行,滿足不同地區、不同治理要求的企業;

- 搭配 AWS 的認證、計費與

SLA,變成企業 IT 生態中的「安全 Agent 層」。

AWS 自己也沒有閒著:Reddit 上討論熱烈的 Amazon Bedrock AgentCore Payments,直接給 Agent 一個可控的錢包,透過 x402 協定讓 Agent 能自主支付 API、資料、甚至其他 Agent 的服務費。這把 Agent 正式推入 「自我消費」的商業模式。

總結這三家:

- Google:從 OS 下手,搶「消費者端日常工作流程」;

- Apple:死守入口與預設控制權,把 AI 當系統功能而非平台;

- OpenAI / Anthropic / AWS:深挖「企業工作流程」與治理,讓 Agent 成為企業內部的服務層。

💡 關鍵: 平台之戰已從「誰的模型最強」轉變為「誰能掌控日常與企業工作流程中的預設 Agent 與服務層」。

真正的分水嶺不再是「誰模型比較強」,而是:誰能把 Agent 變成穩定、可信、可治理的「新 OS / 新雲 API」。

三、Agentic OS 的技術門檻:開發者面對的是一個「後 RAG 時代」

從技術與生態來看,Google 這次要做的 Agentic OS,其實踩在幾個未爆彈上。

1. 離線推理 + 隱私:OS 級 Agent 的必要條件

要讓 Agent 住在 OS 裡,而不是只在雲端跑聊天介面,至少要滿足:

- 端上推理能力:部分任務不再需要雲,這對行動裝置與眼鏡尤為關鍵;

-

隱私與合規:日常操作由 Agent 接管,意味著它會接觸:

-

郵件、檔案、行事曆、訊息、甚至感測器資料;

- 如果沒有系統級的權限沙箱與審計軌跡,企業與監管不可能買單。

Google 想用 Aluminium OS + Android XR 把這些變成 default capability,這對開發者的意味是:

- 你必須設計 可部分端上、部分雲端運行 的 Agent 工作流;

- 必須考慮 資料分界線:哪一段邏輯可以交給端上模型,哪一段要上雲端;

- 隱私與權限將從「App = 沙箱」變成「Agent = 受控但跨 App 的 orchestrator」。

2. 後 RAG 時代:Agent 不是大型 chatbot,而是長鏈任務調度器

Towards AI 上那篇 〈RAG Was Built for Chatbots. Agents Are Breaking It〉 已經說得很白:

- 傳統 RAG 在 Agent 場景下,85% 的算力被消耗在檢索;

- 任務完成率僅 50–60%,瓶頸不在模型,而在架構;

-

Agent 的需求不是「找幾段文件放進

context」,而是: -

多步決策;

- 多工具、多 API 協同;

- 長時間狀態管理。

💡 關鍵: 當 85% 算力被卡在檢索、任務完成率只有 50–60% 時,問題已不在模型,而在整個 RAG 架構與任務調度設計。

如果 Google 要在 OS 裡跑 Agent,勢必要提供一套 取代 RAG 的新基礎架構:

- 面向 Agent 的記憶、工具調度、工作流引擎;

- 不只是向量資料庫,而是 任務狀態存儲+決策快取;

- 對開發者來說,這會變成新的「Agent SDK / Runtime」,類似當年的

Android SDK——只不過這次是給 Agent 不是給人類使用者。

若這一層沒有被做好,所謂 Agentic OS 就只是「在 OS 裡執行一個聊天程式」而已。

四、這波變化對開發者與使用者的實際意義

對開發者:把產品線拆成「給人用」與「給 Agent 用」

接下來 2–3 年,開發者會遇到幾個具體決策:

-

設計「Agent-friendly API」:

-

你的服務需要提供乾淨的 API、明確的

schema、錯誤碼,方便 Agent 理解與重試; -

支援細緻的權限與計費,甚至要預留 Agent 自付費 的接口(對接像 AgentCore Payments 這種機制)。

-

把「工作流程」變成主要產品:

-

不要只想「做一個 App」,而要想「做一個 Agent 能代你完成的

end-to-end workflow」; -

多思考如何讓自己的服務嵌進 Gemini / Claude / OpenAI 的 Agent 流程,而不是只做獨立前端。

-

投入治理與可監管性設計:

-

企業客戶會問的不是「你用了哪個模型」,而是:

- 誰審核

prompt? - 誰可以查看執行紀錄?

- 失誤怎麼追責?

- 誰審核

-

這正是 OpenAI、Anthropic、AWS 正積極提供的能力,也是 Google 目前相對弱的一環——這也剛好是開發者可以補位的地方。

對一般使用者:你的日常操作即將被「默默接管」

對一般使用者來說,這一波不是某個 App 升級,而是「你與裝置互動的基本單位」要變了:

-

你不再是點開十個 App;你是說「幫我處理這件事」,然後 Agent 幫你:

-

看信、回信、訂票、排程、填表、付款;

-

你甚至不一定知道哪個 App 在背後運作,因為它們變成被 Agent 調用的「服務模組」。

這會帶來兩個風險與一個現實:

-

風險一:控制權更難感知

-

誰是預設 Agent?

- 它用哪個模型?

- 它把你的資料送到哪裡?

-

你可能只看到一個看似溫和的系統助理,背後卻是 Google / Apple / OpenAI 的治理博弈。

-

風險二:錯誤與偏差變成「系統層問題」

-

過去是一個 App 做錯;

-

未來是一個 Agent 在 OS 層做錯——影響範圍更廣,責任歸屬也更模糊。

-

現實:你很難完全不參與

-

工作場所會導入企業 Agent;

- 手機 OS 會推送系統級 AI 功能;

-

你能做的不是「不用」,而是:

- 理解哪一些任務適合交給 Agent;

- 認真看一次權限與預設設定;

- 在關鍵決策上保持人工覆核。

最後一句話:

Google I/O 2026 是 Google 最接近重新定義「作業系統是什麼」的一次嘗試,但真正的勝負不在模型 SOTA,而在能否把 Agent 變成穩定、可信、可監管的「新 OS API」。

對開發者而言,現在就該開始把產品拆成「給人用」與「給 Agent 用」兩條線,把自己的服務設計成可被 Agent 調度的能力;對使用者而言,則要學會把「預設 AI」視為系統級選項,像看待隱私設定一樣認真檢視——因為這次被改寫的,不只是你裝了哪個 App,而是你每天怎麼操作電腦與手機這件事本身。

🚀 你現在可以做的事

- 檢視現有服務的 API 設計,調整為適合 Agent 調用的「能力模組」

- 追蹤

Gemini 4、Android XR、Aluminium OS與Claude Managed Agents的開發文件與 SDK- 打開手機與工作環境中的預設 AI/Agent 設定,逐一檢查權限與預設選項