📌 本文重點

- ChatGPT 正試圖成為你的「個人財務作業系統」

- 真正風險在於資料權力、責任邊界與監管真空

- 在制度未完善前,用戶需自建三道安全防線

OpenAI 把 ChatGPT 接上你的銀行帳戶,真正的賭注不是「幫你少點幾次外送」,而是搶佔「個人財務作業系統」的位置。功能創新值得肯定,但在資料、責任與監管都還沒補齊前,預設信任這套系統,是一場豪賭。下面要談的,是這場豪賭背後的權力重分配。

從聊天機器人到「個人財務 OS」

事實層面有幾個關鍵變化:

- OpenAI 宣布與 Plaid 整合,ChatGPT 可「安全連線」超過 1.2 萬家金融機構,包括 Schwab、Fidelity、Chase、Capital One 等主流銀行。

- 用戶一旦授權,ChatGPT 就能看到你的投資組合、消費明細、訂閱與即將到期付款,甚至是信用卡債務與現金流狀況。

- 根據官方說法,每月已有 超過 2 億人用它問理財問題,這次是從「回答抽象問題」,升級成「直接操作你的真實帳本」。

💡 關鍵: 一旦讓能觸達「超過 1.2 萬家金融機構」且每月服務「2 億人」的 AI 看懂你的帳本,入口與話語權就從銀行轉移到模型提供者手中。

這一刀切下去,ChatGPT 從「強化版 Google 搜尋+筆記工具」,直接升級為跨平台的財務中控台:

- 不再只是幫你算「如果每月多存 500 美金會怎樣」,而是看到你哪張卡快逾期、哪個訂閱忘了取消,甚至可以幫你擬一份砍支出的行動清單。

- 對用戶來說,這是把散落在各銀行 app、券商平台、Excel 裡的資訊,集中在一個能聽懂自然語言的介面上,便利性是質變級的。

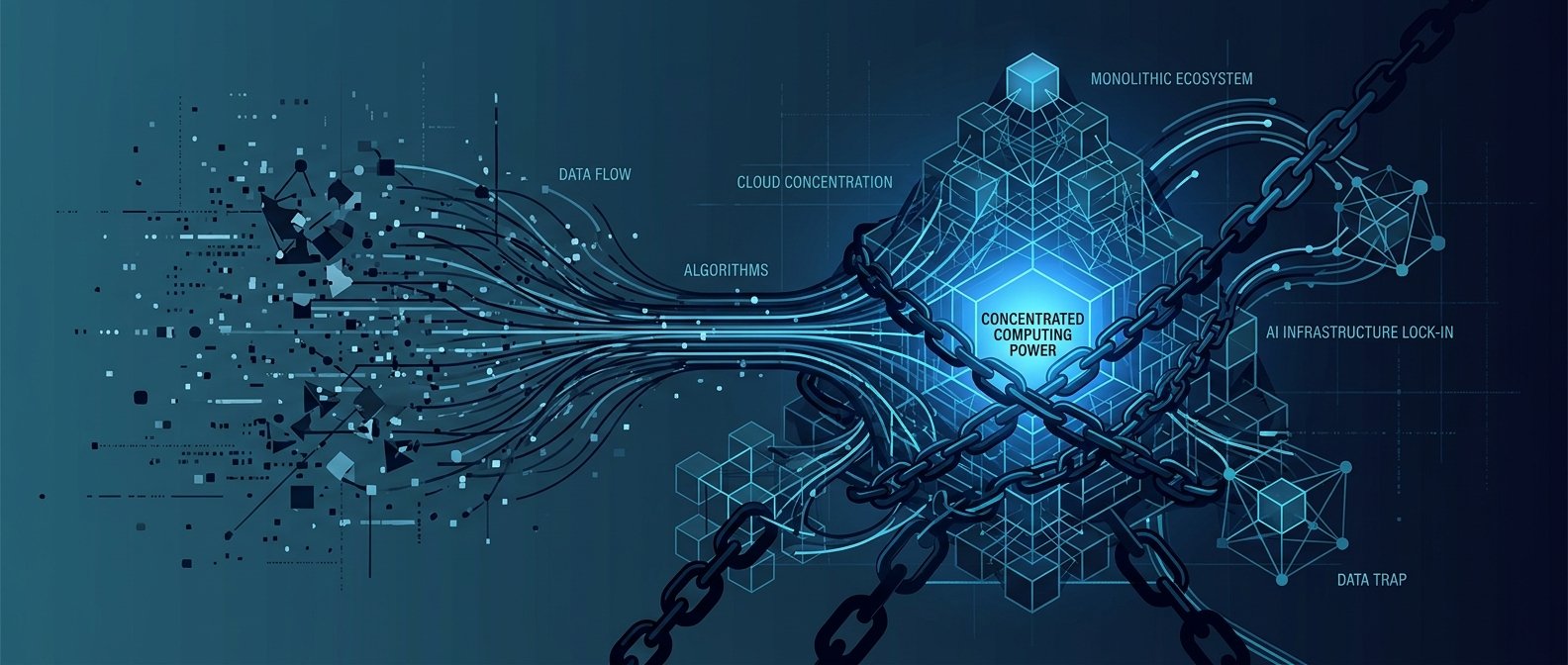

- 對金融業而言,這不是「多一個聊天功能」,而是:

- 傳統銀行與券商的 app 被降格為「資料提供後端」,

- OpenAI 變成你日常金融決策的第一入口——誰掌握入口,誰就掌握未來的金融產品分發權。

換句話說,這次更新是 AI 商業化的典型戰略:借 Plaid 進金融系統的「正門」,用 UX 優勢搶走用戶與傳統金融機構之間的互動主導權,完成從工具到平台/OS 級別產品的跳躍。

三個隱藏風險:資料權力、責任邊界、監管真空

功能很香,但如果你預設信任,就等於把三層防線拱手讓人。

1. 資料權力:誰在「看懂」你的財務人生?

技術上,OpenAI 強調透過 Plaid 的機制進行「嚴謹授權」,你可隨時斷開連線,聽起來安全、可控。但真正的權力不在「能不能連」,而在「連上之後誰有理解能力」。

- 銀行一直都知道你的交易紀錄,卻很少真的「理解」你——最多拿去跑風控或行銷模型。

- 把帳本交給 ChatGPT,則是把「解讀你行為、預測你下一步」的能力交給一個通用 AI:

- 它可以推估你的風險偏好、壓力點(什麼時候會賣在低點)、消費習慣和衝動觸發點。

- 結合其他產品(搜尋、電商、廣告),就有潛力變成全方位的行為預測引擎。

這裡的問題不只是「會不會被駭」,而是:

從此以後,真正最懂你財務行為的人,不是你自己、不是你的銀行,而是 AI 模型的提供者。

在尖端 AI 訪問權越來越集中、成本越高的趨勢下(參考對 frontier AI 訪問將被成本與安全限制的討論),掌握這類高價值個資的巨型科技公司,會在競爭中取得更難被追上的資料護城河,中小金融機構將被迫依附在這些「AI 中樞」之下。

2. 責任邊界:AI 給錯建議,誰來買單?

OpenAI 清楚提醒:「ChatGPT 不是持牌理財顧問」,建議僅供參考。這句話法律效果很大,實務上卻很虛。

對一般人而言:

- 當一個看得到你完整帳本、現金流、負債和投資部位的系統,給出「你應該增加美股持股」或「可以多貸一點沒關係」這類建議時,你真的會把它當成「隨便聊聊」嗎?

- 你把最敏感的資料給它,它卻在關鍵時刻可以一句「我是聊天機器人,不是顧問」抽身,這是資訊與責任嚴重失衡。

對照傳統金融:

- 持牌理專、理財顧問必須遵守適合度評估、風險揭露等規範,給錯建議有明確的追訴與賠償機制。

- Robo-advisor 在多國也被納入證券或投顧監管框架,需要揭露投資邏輯、風險等級,甚至保留審計軌跡。

現在的 AI 助理則是:

擁有比多數人類顧問更完整的資料視角,卻不承擔相應的受託責任。

這讓大型科技公司實質扮演「高智慧投顧」,但法律地位卻是「娛樂聊天工具」,形成典型的責任套利。

3. 監管真空:科技公司變身影子金融機構

從監管角度,這類 AI 理財助理目前大多被視為「科技服務」而非「金融服務」。這創造了一個灰色地帶:

- 它不直接代你下單、不代管資產,就很可能不被認定為投資顧問或金融機構。

- 但它實際上深度影響你的資產配置與風險承擔行為,比很多財經 Youtuber 還具說服力。

相比之下,傳統 robo-advisor 在多數市場都被當作金融機構來監管,必須:

- 接受資本適足率要求、資訊揭露、投資限制等規範;

- 定期向監管機構報告模型策略與風險控管。

而現在的 AI 理財助理,則可能成為:

繞過監管、影響實體資產的「影子金融機構」。

當數以億計的人把投資與消費決策的第一道過濾交給 ChatGPT,任何模型調整、商業合作(例如導流到特定券商或信貸產品),都可能在缺乏透明的情況下改變大量人的行為,監管卻難以及時介入。

💡 關鍵: 當 AI 既非持牌機構、又能大規模左右投資與借貸決策時,實質影響力與法律責任將出現巨大斷層。

三道防線:先架好,再考慮要不要讓 AI 看帳本

我不認為應該一刀切拒絕這類 AI 理財助手。對許多財務焦慮但缺乏時間與知識的人,它可能是第一個讓財務狀況「看得懂、算得清」的工具。

但在制度還沒追上之前,用戶與產業至少要把三道防線握在自己手上:

1. 資料最小授權:把權力拆碎

- 只在必要時、對必要帳戶授權,先從風險最低的帳戶開始(例如日常支出帳戶,而非全部投資與貸款)、避免把完整資產圖一次攤給同一個 AI。

- 定期檢查並關閉不再需要的連線,把「預設永久連線」改成「預設暫時授權」。

- 關注服務條款中,資料是否會被用於模型訓練、廣告或第三方共享,能關掉就關掉。

2. 資產與決策分層:讓 AI 只能碰「建議層」

- 短期內,讓 AI 停留在「整理資訊、輔助思考」層級,而不是「自動執行」層級。

- 對關鍵決策(加槓桿、集中持股、變更退休規劃),至少保留 24 小時冷卻期,用另一套工具或人類顧問做二次確認。

- 對開發者而言,把產品設計成:

- 上層是 AI 建議與解釋,

- 下層是人類確認與執行,

這種「分層架構」,而不是一鍵自動化。

3. 要求監管進場:把「AI 金融輔助」拉進現有框架

產業與使用者都應該主動要求監管,而不是等出事再補:

- 監管機構應將「持續存取個人金融帳戶並提供個別建議的 AI」,納入類似 robo-advisor 的規範:

- 要求風險揭露與適合度評估,

- 要求提供「為何給出這個建議」的透明度與審計軌跡。

- 禁止以「我是聊天機器人不是顧問」作為一切責任切割點,至少在明顯誤導或系統性錯誤時,需承擔明確責任。

- 在 AI 訪問權愈趨集中之際,監管應避免形成「少數科技巨頭+全市場金融行為資料」的壟斷結構。

結論很簡單:

- 個人層面:你可以把 ChatGPT 當成第一個幫你「對帳、算現金流」的 AI 工具,但不要把人生財務主權交給一個預設免責的黑箱系統。

- 產業與監管層面:不要再把這類產品當成「聊天小玩具」,而要正視它們已經是實質影響資產配置的金融基礎設施。規則要跟上,責任要對等,資料權力必須被重新分配。

在那之前,每一次點擊「連接我的銀行帳戶」,都應該先問自己一句:這個便利,值不值得我付出這麼大的信任成本?

🚀 你現在可以做的事

- 打開你的銀行與投資帳戶,清點目前連接到任何第三方或 AI 工具的授權,關閉不必要的長期連線

- 下次使用 ChatGPT 問理財前,先限定只提供「必要資料」,並刻意保留 24 小時冷卻期再做重大決策

- 關注你所在國家的金融監管公告,遇到相關 AI 理財諮詢公開徵詢時,主動提交意見、要求納入責任與透明度規範