📌 本文重點

- Claude 透過 MCP 直接遠端操作 Blender / Photoshop / Ableton

- 文字或語音就能生成場景、批次改圖與拉編曲草稿

- 適合接案設計、3D 新手與小工作室提升產能

- AI 負責「動手」、人類負責審核與最後決策

用一句話講完:Claude 現在可以直接「動手幫你點 Photoshop、拉 Blender、調 Ableton」,把原本要慢慢點選單的操作變成一句話完成。

文中提到的功能,來自 Anthropic 官方的 Claude 連接器(connectors / MCP),可參考:官方介紹、The Verge 報導。

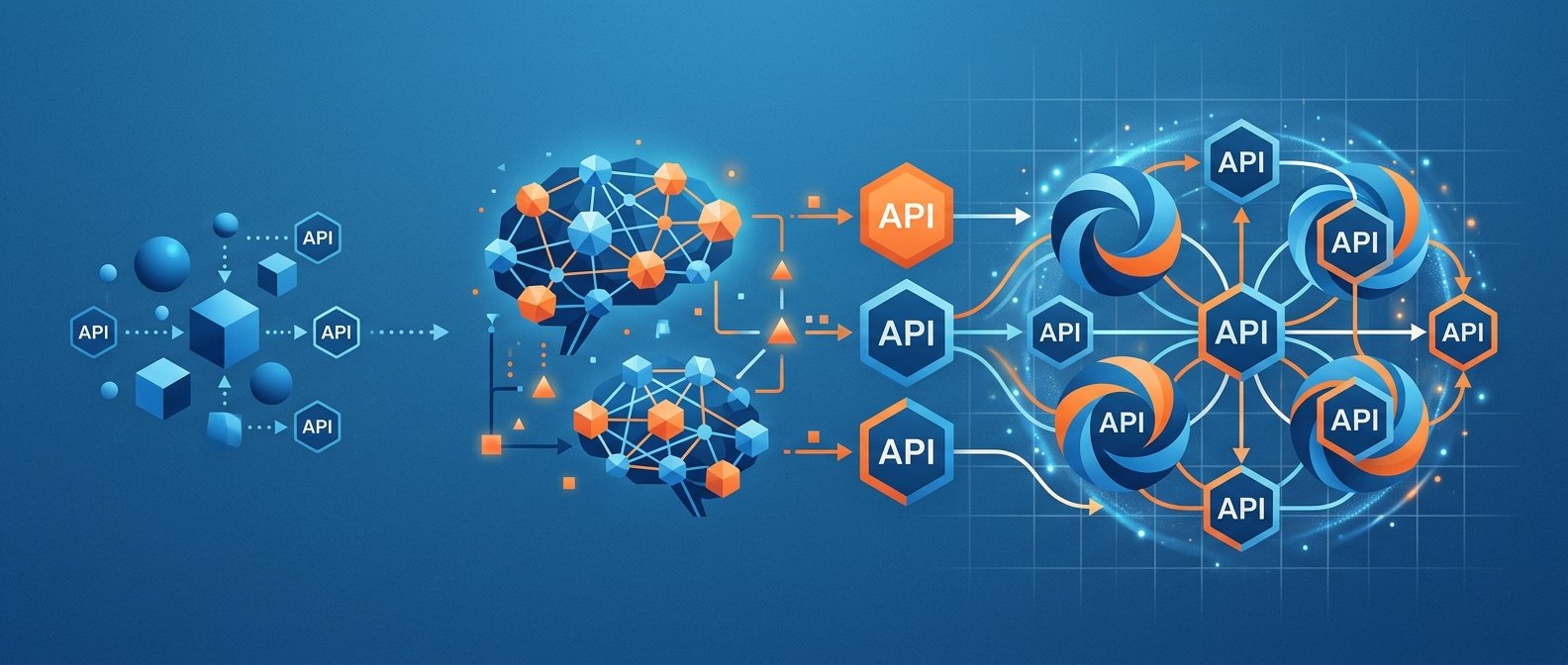

核心功能:先搞懂 MCP / Connector 是什麼

先用白話講:

- MCP(Model Context Protocol):一個「統一插頭」,讓 Claude 能安全地跟電腦上的軟體溝通。

- Connector(連接器):插上這個「插頭」的具體線,比如 Blender 連接器、Photoshop 連接器、Ableton 連接器。

你在 Claude 視窗打字(或用語音),它就會透過這些連接器,去幫你在軟體裡做事:

不是教你怎麼點,而是直接幫你點。

💡 關鍵: MCP 就像一個標準插頭,讓同一個 Claude 可以安全地「代操作」多種專業軟體,而不用每套軟體各自學一次指令。

下面分軟體看可以做什麼,對應你可以立刻試的操作。

1. 在 Blender 裡:從「文字」變成「場景」

已知可做到的事(參考 Blender MCP 討論):

- 用一句話生成低模場景

- 自動清理 3D 掃描(減面、去雜訊、重新擺正)

- 批次改物件、材質、節點

- 調燈光、相機與渲染設定

你可以直接試:

中文範例

「請用 Blender 連接器幫我:

1. 建一個低多邊形海灘場景,有海水、沙灘、幾棵椰子樹和夕陽光線。

2. 幫場景加三個鏡頭角度,並各渲染一張 1080p 圖片。

完成後把相機位置和燈光設定整理成註解寫在場景裡。」

English prompt

“Using the Blender connector: create a low poly beach scene with palm trees and warm sunset lighting. Set up three different camera angles and render 1080p images for each. Add comments in the scene explaining the camera and lighting setup so I can learn from it.”

如果你有 3D 掃描模型(例如 KIRI Engine 匯出的 .obj):

「我已經在 Blender 開了一個場景,裡面有一個植被很多的 3D 掃描模型:

– 幫我移除空中漂浮的碎片、把面數降低但保留大形體。

– 調整模型讓主要主體正立,放在世界原點附近。

– 加一套簡單三點打光並渲染 1 張預覽圖。」

2. 在 Photoshop(或 Adobe 系列):用文字批次改圖

依據 The Verge 報導,Claude 的 Adobe 連接器可以:

- 建立新檔、開啟指定檔案

- 新增 / 重新命名 / 隱藏圖層

- 批次套用濾鏡、調整顏色

- 幫你把繁瑣的重複動作寫成動作 / 腳本風格流程

你可以直接試:

「使用 Photoshop 連接器,幫我開啟這個專案檔:

branding_master.psd。

1. 找出所有 LOGO 圖層,統一命名規則為logo/版本名稱。

2. 把所有社群貼文尺寸的畫板,輸出為 1200×1200 PNG,背景保持透明,存到桌面的export/social資料夾。」

再試一個批次調色:

“Use the Adobe Photoshop connector to:

– Duplicate the current file.

– Create a new adjustment layer that slightly increases contrast and saturation for social media.

– Apply it only to layers tagged as product shots and export them as high-quality JPGs in a newsocial_tunedfolder.”💡 關鍵: 透過 Photoshop 連接器,原本要手動點選數十次的批次輸出與調色,可在一個指令裡一次完成,省下大量重複勞動。

3. 在 Ableton:用語音/文字拉出編曲草稿

根據官方說明,Ableton 連接器可以:

- 建立 MIDI clip、放進不同 track

- 調整節奏、loop 長度

- 插入預設樂器和效果器

你可以直接試:

「用 Ableton 連接器幫我建立一個 120 BPM 的 lo‑fi 草稿:

– 4 小節鼓組 loop、4 小節貝斯循環、8 小節和弦鋪底。

– 風格接近 chillhop,請幫我選擇合適的內建音色。

– 完成後 loop 成 90 秒,並匯出一個 MP3 demo。」

常見連接器對照表

| 名稱 | 核心功能 | 免費方案 / 價格狀況* | 適合誰 |

|---|---|---|---|

| Blender Connector | 生成低模場景、清理掃描、批次改物件 | Blender 本身免費;Claude 需帳號 | 3D 新手、接案 3D 設計、技術美術 |

| Adobe Connector | 控制 Photoshop / Illustrator 等操作 | 需 Adobe 訂閱+Claude 帳號 | 視覺設計、品牌設計、社群素材製作者 |

| Ableton Connector | 建立 clip、調 tempo、插入樂器與效果 | 需 Ableton 授權+Claude 帳號 | 音樂製作人、Podcast / 影片配樂創作者 |

*實際價格依 Anthropic / 各軟體官方方案為準。

💡 關鍵: 軟體本身的授權費用照舊,只要多一個 Claude 帳號,就能把同一套 AI 工作流套用到 3D、平面與音樂三種不同領域。

適合誰用:三種典型工作流

1. 接案設計師:快速出 2–3 套草稿

痛點:提案時間永遠不夠,客戶只看得見「改幾版」的速度。

可以這樣用:

- 在 Photoshop 連接器裡,讓 Claude 幫你:

- 批次換配色(品牌 A / B / C)

- 自動重排文案位置產生幾個版型

- 一次輸出多尺寸(FB、IG、Story)

示範提示詞:

「我有一套活動主視覺 PSD,請用 Photoshop 連接器幫我:

1. 複製成三個版本:藍色科技感、綠色環保感、紅色節慶感。

2. 每個版本輸出 1920×1080 與 1080×1080 各一張 JPG,壓縮適合網路使用。」

2. 3D 新手:用語音完成原本要學幾週的操作

痛點:從「什麼是 Modifier」到「會做一個完整場景」中間的學習斷層很大。

把 Claude 當成 3D 技術長:

- 讓它先幫你生成場景

- 再請它用註解方式教你每一步為什麼這樣做

示範提示詞:

「用 Blender 連接器幫我做一個簡單的『賽博朋克風格房間』:

– 包含牆壁、桌子、椅子、一扇窗戶和幾個霓虹燈招牌。

– 每做完一步,請在場景中用 Text 或註解標出用到的 Modifier / Node,並用給初學者看的方式解釋。」

這種用法不是要你完全不學,而是先讓你有東西可以拆解和模仿。

3. 小工作室:把重複性建模與場景調整交給 AI

痛點:案子多、人手少,很多時間浪費在「一點點改動但要改很多檔」。

可以把 Claude 當「批次處理工程師」:

- 批量改 20 個產品模型的尺寸或命名規則

- 為一整批場景統一燈光風格

- 自動加上 Render Layer、AOV 等技術設定

示範提示詞:

“Using the Blender connector, go through all objects whose name starts with

prod_:

1. Uniformly scale them so their longest dimension is 1.5m.

2. Apply scale and center them on the ground plane.

3. Set up a consistent three-point lighting rig and a 4K render preset for turntable animations.”

怎麼開始:一個晚上跑完第一個 AI + Blender / Photoshop 專案

步驟 1:安裝 Claude 桌面版

- 到 Anthropic 官網下載桌面版 Claude(目前支援 macOS / Windows):https://www.anthropic.com

- 用你的帳號登入(有地區或方案限制時,依官方最新說明為準)。

步驟 2:在 Claude 內啟用連接器

- 打開 Claude 桌面版,找到 Connectors / 連接器 目錄(通常在側邊欄或設定中)。

- 在列表中找到:

- Blender Connector / Blender MCP

- Adobe / Photoshop Connector

- Ableton Connector

- 按「啟用」或「Add」,依提示授權存取你的軟體(可能會需要:

- 安裝一個 Blender 外掛

- 在 Adobe / Ableton 裡允許外部控制 / API)

- 確認 Claude 視窗中可以看到類似「Blender 連接器已可用」的訊息。

步驟 3:建立你的第一個專案流程

建議你照這個順序玩一輪,一個晚上夠用:

- Blender:生成一個低模場景

-

在 Claude 打:

> 「請使用 Blender 連接器,從空白場景幫我建立一個低多邊形咖啡廳內部,並渲染一張 1920×1080 圖。」 -

Photoshop:接手做後製

- 把剛剛渲染圖匯入 Photoshop 專案。

-

在 Claude 裡說:

> 「用 Photoshop 連接器,幫我在這張圖上加上柔和的暗角與暖色調色,並加一個簡單的標題排版。」 -

Ableton(選擇性):做一小段配樂 Demo

- 在 Claude 中下指令,讓它用 Ableton 連接器做 30–60 秒的 BGM 草稿。

做到這裡,你就完成了:

一個 Blender 場景 → Photoshop 調整 → Ableton 配樂的「全 AI 代操」小專案。

實用安全界線:哪些步驟一定要人工檢查?

AI 可以幫忙「動手」,但這幾件事建議你一定要自己看過:

- 3D 模型結構

- 工程用途(3D 列印、製造)時,一定要檢查:尺寸、厚度、是否有穿模、布林是否正常。

-

可參考這篇完全用 Claude 建模樹莓派外殼的例子,但作者也強調自己有做實體驗證:Raspberry Pi 外殼實例。

-

美術風格與品牌一致性

-

Photoshop 產出的調色與排版,只是起點,仍要你自己調校成符合品牌指引的版本。

-

版權與素材來源

-

若 Claude 幫你拉進外部素材(字型、圖片、音樂 loop),要確認授權是否可商用。

-

效能與檔案體積

- 大型場景、4K 貼圖、複雜節點:請注意電腦吃不吃得下,必要時指示 Claude:

> 「請優先考慮效能,把貼圖解析度、粒子數量控制在中等。」

只要把 AI 當成「會操作軟體的助手」,而不是「最終負責人」,就能在安全範圍內,把重複操作、初稿生成通通丟給它處理。

行動建議總結:

- 今晚先安裝 Claude 桌面版+啟用 Blender 連接器。

- 用文中範例 prompt 做出第一個低模場景,再丟到 Photoshop 做一版海報。

- 每做完一個步驟,就要求 Claude 把操作邏輯寫成註解,順便當學習筆記。

跑完一輪,你就會開始習慣:

「我負責決定要做什麼,Claude 負責幫我在 Blender / Photoshop / Ableton 裡動手做。」

🚀 你現在可以做的事

- 到 Anthropic 官網下載 Claude 桌面版,並在設定中啟用至少一個你常用軟體的連接器

- 挑本文任一範例提示詞,實際在 Blender 或 Photoshop 中跑完一個完整小任務

- 在每次 Claude 操作後,手動檢查成果並要求它生成「操作說明註解」,累積成自己的工作流模板